IA e Machine Learning nelle scienze molecolari e dei materiali

advancedcfo.com

Articolo a cura di Vincenzo PEPE

Il ventunesimo secolo si è rivelato propizio nel campo dell’Intelligenza Artificiale (IA). Passi da gigante sono stati compiuti anche nelle scienze molecolari e dei materiali. L’individuazione del catalizzatore per la conversione dell’anidride carbonica in etilene. La scoperta di materiali per la raccolta e lo stoccaggio dell’energia. La progettazione di farmaci assistita da computer. E questi sono solo alcuni dei tanti esempi…

DFT

I moderni strumenti di simulazione consentono inoltre di anticipare le proprietà di un composto con ragionevole accuratezza, prima che sia stato studiato in laboratorio. Un esempio è la teoria del funzionale della densità (DFT).

Una teoria quantistica microscopica per lo studio di sistemi a molti elettroni ed una tecnica matura per la previsione della struttura e del comportamento dei solidi. Essa ha permesso lo sviluppo di vasti database che contengono le caratteristiche di sistemi noti e ipotetici, inclusi cristalli organici e inorganici, singole molecole e leghe metalliche.

Machine Learning

Uno dei settori dell’intelligenza artificiale che si sta evolvendo a ritmi sbalorditivi è il machine learning: esso si basa su algoritmi statistici le cui prestazioni migliorano con il continuo utilizzo. A differenza dei metodi convenzionali, basati su algoritmi hard-coded, attraverso il machine learning, che analizza un set di dati, il computer ha la capacità di determinare tutte le leggi fisiche e potenzialmente anche quelle che sono ancora sconosciute senza un input umano potendo così affrontare problemi complessi che coinvolgono ingenti spazi combinatori o processi non lineari.

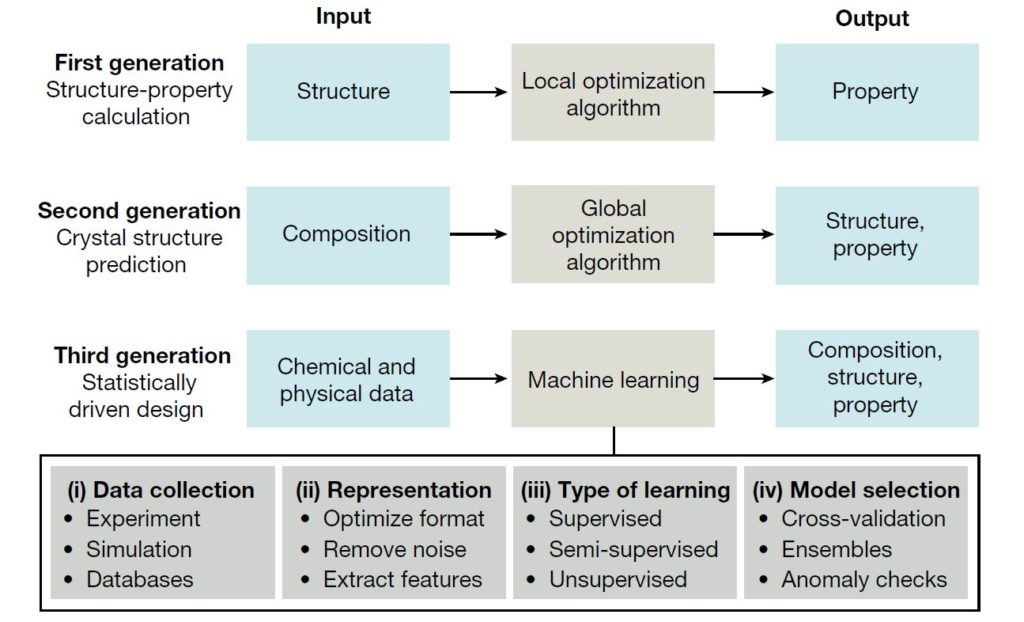

La figura riporta l’evoluzione dello schema di ricerca nella chimica computazionale. Nell’approccio di prima generazione si calcolano le proprietà fisiche di una struttura in input tramite un’approssimazione dell’equazione di Schrödinger. Nell’approccio di seconda generazione, attraverso un algoritmo evolutivo un input di composizione chimica viene mappato su un output che contiene previsioni sulla struttura o sull’insieme di strutture che la combinazione di elementi potrebbe adottare. L’approccio emergente, di terza generazione, consiste nell’utilizzare tecniche di machine learning con la capacità di prevedere la composizione, la struttura e le proprietà a condizione che siano disponibili dati sufficienti e che sia utilizzato un modello appropriato.

Le fasi fondamentali per la realizzazione di un modello di machine learning efficace sono 4:

- raccolta dei dati, che devono essere esenti da errori per evitare che gli algoritmi del machine learning vengano fuorviati. Un esempio è il database delle strutture dei cristalli inorganici (ICSD) che comprende attualmente più di 190.000 voci;

- rappresentazione dei dati, che devono essere convertiti in qualcosa di comprensibile per l’algoritmo;

- scelta del tipo di apprendimento, che può essere supervisionato, semi-supervisionato e non supervisionato a seconda della richiesta che viene avanzata alla macchina;

- ottimizzazione del modello, che prevede l’eliminazione o la diminuzione dei tre errori fondamentali ovvero bias (o tendenza del modello), varianza del modello ed errori irriducibili.

In conclusione, questa nuova generazione di scienza computazionale ha davvero il potenziale per spingere oltre i limiti il mondo scientifico.